異分野融合で新たな先端研究を目指す「人間知×脳×AI研究教育センター(CHAIN チェイン)」センター長の田口茂さんは、自身の専門分野である「哲学」と、最新分野の「AI(人工知能)」、「神経科学(脳科学)」を結びつけるという先端的な研究に挑戦しています。田口さんが哲学を志したきっかけや、ご自身の研究について、さらにCHAIN発足の経緯と展望を聞きました。

―田口先生は哲学がご専門ですが、哲学に興味を持ったきっかけは何ですか?

田口 小さい頃からいろいろなことを考えるのが好きでした。例えば、宇宙はどこにあるんだろうと考えて、友達に聞いてもわからないし、親に聞いても「そんなことばっかり考えてないで勉強しなさい」と言われて、誰も答えてくれませんでした。高校生の頃に大学でどんな学問をやろうかと思ったときに、自分は人間について興味があるから文学部に行こうと思い調べていると、その中に「哲学」というのを見つけました。どんなものかなと思って本を読んでみたら、自分が小さいころからあれこれ考えていたことは、実は哲学だったんじゃないかと気づきました。哲学なら、自分が今までやってきたことをさらに大々的に、大手を振ってやれるわけだからすごくいいな、自分の役に立たないと思った妄想が結構役に立つかもしれないと思いました。宇宙はどこにあるのかという疑問も、ちゃんと哲学的な問いになるんだと気づきました。それで哲学に興味をもって、大学でやりたいと思ったんです。

人間知×脳×AI研究教育センター長を務める田口茂教授

人間知×脳×AI研究教育センター長を務める田口茂教授―田口先生が取り組んでいる研究テーマについて教えてください。

田口 1つは数学者の西郷甲矢人(さいごうはやと)さんと、15年くらい共同研究をしているテーマがあります。数学の「圏論(けんろん)」という、矢印を使って数学の世界を表現する方法を使って、時間や生物の中の自律性という哲学的な概念を表現する研究をしています。私がずっとテーマにしてきた「自己」とか「意識」についても、圏論的なアプローチで考えられないか検討しています。それから、神経科学者でCHAIN教授の吉田正俊さんとも、エナクティヴィズムとか、エナクティヴアプローチといわれる考え方をテーマに共同研究しています。エナクティヴィズムとは、我々が行動することによって初めて世界を知ることができるというのを根本に置いた認知科学の考え方です。そういう身体的な行為を中心にして、人間の意識や、社会性、他人とのコミュニケーションを考えられないか、ということを研究しています。 お二人とも私にとって異分野の研究者ですが、自分1人だったら全然届かないようなところに、彼らの頭脳を通して届くことができます。お互いに別々の二人の脳がくっついたような体験ができるというのが異分野の方との共同研究の面白さでもあり、非常にワクワクします。

―異分野融合の拠点であるCHAINはどういう経緯で設立されたのでしょうか?

田口 CHAINは2019年7月に開設しました。もともとは、文部科学省の大学院改革の一環で、卓越大学院というプログラムに応募するために、AIと人間社会との関わりをテーマとした教育プログラムが立てられないか、という議論が文学研究院で始まったことがきっかけでした。その中で、人間を知ることがAIの発展につながり、逆にAIを鏡にして人間を理解できるというアイデアが中心になってきて、これは非常に面白いプロジェクトになるだろうと、若手の教員を中心に盛り上がりました。それで、人間について多角的に考えていく学際的なセンターを設立して、教育プログラムを作ろうということになり、CHAINが誕生しました。人文社会科学とAIと脳科学を同格に研究する施設は、世界的にも珍しいと思います。

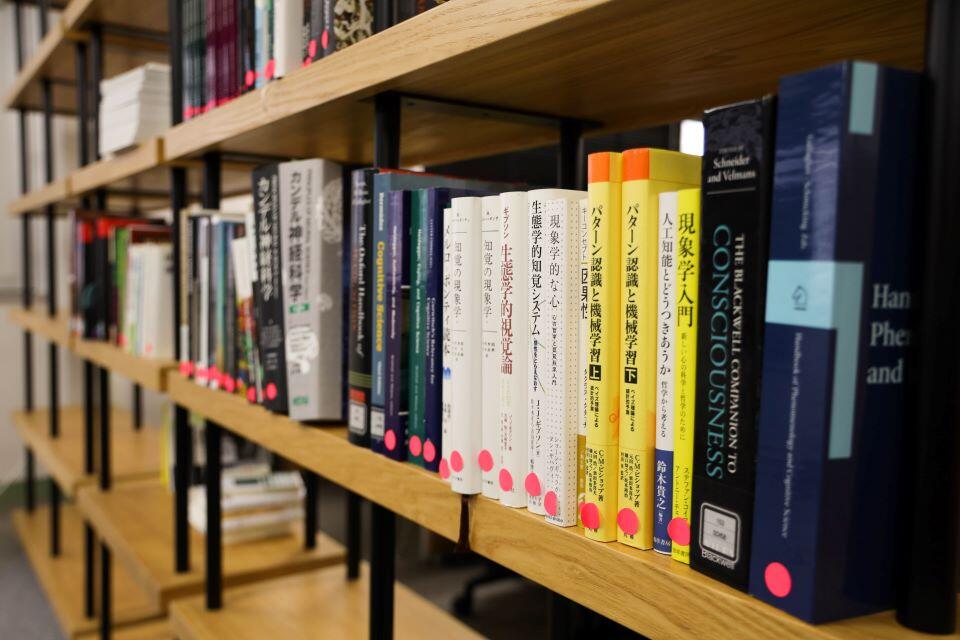

哲学や科学の専門書が並ぶ本棚

哲学や科学の専門書が並ぶ本棚―「AIを鏡にして、人間を理解する」とはどういうことでしょうか?

田口 例えば私の好きな研究で、「退屈できるAIエージェント」の研究があります。AIのアルゴリズムや製品開発などを手掛けるスタートアップ企業「アラヤ」の研究で、仮想環境をAIエージェントがいろいろ探索するのですが、退屈できるエージェントの方がきちんと効率的に環境を探索できるというものです。退屈できないAIエージェントは同じ行動ばかり繰り返したりしてしまうのですが、一方で退屈できるエージェントは、ある一定のところで「これはもうすでに何度もやったから、退屈したな」ということで、他の行動をとるようになり、結果として環境の中を効率的に探索します。人間にとって退屈はあまり意味がない、ネガティブな性質だと思われがちで、「退屈しやすい、飽きっぽい人だ」と怒られてしまったりもします。だけど、実は退屈できるということが、人類の進化の歴史の中で重要な役割を果たしてきた可能性も、このAIの実験から見えてきます。人類は退屈できるからこそ、自分の環境をちゃんと探索して、その環境の中で生き抜いてこられたのかもしれない。こんな風に、AIのいろいろな発展を鏡にして、人間のことがわかってくるのです。 ちなみに、「アラヤ」と北大CHAINは今年、社会人向けにAI倫理を包括的に学ぶリカレントプログラムを実施しました。

―CHAINでAIや脳科学、哲学を学際的に学ぶことの良さは何でしょうか?

田口 社会に出て仕事をするとき、単にAIやITだけに向き合っていくだけではだめだと思います。AIと人の間でどういう問題が起こりうるのかを想像できる人が求められていて、そうでないとAIが商品化できません。AIがこれから人間に近くなって社会の中に入っていったときに、いろいろな軋轢が生じるでしょう。AI倫理と言われる分野ですが、 AIそのものが悪につながらないようにするために、倫理的に良いことと許されないことの線引きをする際に、哲学的な考え方がどうしても必要になってきます。CHAINでの学際的な学びはそこに活かせると思います。

実験室にて

実験室にて―CHAINの展望を教えてください。

田口 私たちが取り組んでいることの一つに、哲学的なアイデアをAIの実験に落とし込んで、新しいAIのあり方をデザインしていくという研究があります。例えば、私がこれまで研究してきた「現象学」という哲学の分野では、自分と他人を重ね合わせて他者を理解するというのが他者経験の基本的なモードであるという考え方があります。そこで、AIに自他の重ね合わせのメカニズムを持たせると、自分の学習データだけで他人の目から見た世界の見え方を学習できるようになるという研究成果が出ています。この研究は、他人の脳の情報が入ってこない中で、われわれが自分のなかで他者を理解できるようになる仕組みはどのようなものなのか、他者からはどのように世界が見えているかをなぜ自然に理解し共有できるようになるのかを実証的に解明するヒントを与えてくれます。これはAIだけでも哲学だけでも実現できなかった研究です。 このように、文理融合は一つの分野だけでは成し遂げられないような、非常に新しい知見や方法を生み出せると思います。社会や人間についても科学技術についても関心を持って、融合的な知恵を生かせる能力を持った人、そういうことを考えられる人をCHAINで育てようとしています。

【聞き手:理学部2年(サイエンス・ライティング・インターン)長島実咲(取材当時)

編集・写真:広報・社会連携本部 広報・コミュニケーション部門 齋藤有香】